人工智能数学基础(六) 常见数学函数与激活函数大全——构建人工智能基础软件的基石

在人工智能(AI)的基础开发中,数学是贯穿始终的灵魂,而各类数学函数,特别是神经网络中的激活函数,则是构建智能模型的砖瓦。本文将系统梳理人工智能领域所需的核心数学函数,并重点汇编一份详尽的激活函数大全,为AI基础软件开发提供理论支撑和实践指引。

一、人工智能中的基础数学函数

在AI模型(尤其是深度学习)的构建、训练和优化过程中,以下几类数学函数扮演着至关重要的角色:

- 线性函数:形式为

y = Wx + b。这是神经网络每一层最基础的变换,负责对输入数据进行加权求和。权重W和偏置b是模型需要学习的关键参数。

- 指数与对数函数:

- 指数函数(如 exp(x)):在Softmax函数、某些激活函数(如ELU)及概率模型中广泛应用。

- 对数函数(如 log(x)):是交叉熵损失函数的核心组成部分,用于衡量概率分布之间的差异,是分类任务中最常用的损失函数之一。

- 三角函数(如 sin, cos):在位置编码(如Transformer模型中的正弦余弦编码)、信号处理以及某些特定结构的网络中有重要应用。

- 统计与概率函数:

- Softmax函数:将一组实数(通常是逻辑回归值)转换为概率分布,是多分类问题的标准输出层函数。

- Sigmoid函数:本质上也是一个概率函数,将输入映射到(0,1)区间,常用于二分类输出层或表示概率。

- 高斯(正态)分布函数:在变分自编码器(VAE)、高斯过程等概率生成模型中至关重要。

二、神经网络激活函数大全

激活函数是神经网络的“非线性引擎”,它决定了神经元是否被激活以及如何将输入信号映射到输出。没有它,神经网络将退化为线性模型,无法学习复杂模式。以下是对常见激活函数的系统性

(一)饱和激活函数(早期常用)

- Sigmoid (Logistic函数)

- 公式:

σ(x) = 1 / (1 + exp(-x))

- 值域:(0, 1)

- 优点:输出平滑,易于解释(可作为概率)。

- 缺点:容易导致梯度消失(在两端饱和区梯度接近0);输出不以0为中心,影响梯度下降效率;计算涉及指数,较慢。

- 主要应用:二分类输出层。

- Tanh (双曲正切函数)

- 公式:

tanh(x) = (exp(x) - exp(-x)) / (exp(x) + exp(-x))

- 值域:(-1, 1)

- 优点:输出以0为中心,收敛速度通常比Sigmoid快。

- 缺点:同样存在梯度消失问题。

- 主要应用:循环神经网络(RNN)的隐藏层。

(二)非饱和激活函数(现代主流)

- ReLU (Rectified Linear Unit,整流线性单元)

- 公式:

f(x) = max(0, x)

- 优点:计算极其高效,解决了梯度消失问题(在正区间);收敛速度远快于Sigmoid/Tanh。

- 缺点:“Dead ReLU”问题(负半轴梯度恒为0,导致部分神经元永久失活);输出不以0为中心。

- 应用:最常用,是绝大多数卷积神经网络(CNN)和全连接层的默认选择。

- Leaky ReLU 及其变种

- 公式:

f(x) = max(αx, x),其中α是一个小的正数(如0.01)。

- 优点:解决了“Dead ReLU”问题,为负输入提供了一个小的梯度α。

- 变种:Parametric ReLU (PReLU),将α作为可学习参数;Randomized ReLU (RReLU),在训练时α随机采样。

- ELU (Exponential Linear Unit,指数线性单元)

- 公式:

f(x) = x (if x > 0) else α(exp(x)-1)

- 优点:输出均值接近0,收敛更快;对噪声更具鲁棒性;解决了Dead ReLU问题。

- 缺点:计算涉及指数,稍慢于ReLU。

- Swish 函数 (由Google发现)

- 公式:

f(x) = x * sigmoid(βx),β可以是常数或可学习参数。

- 特点:平滑、非单调。在实践中,尤其在深层模型上,有时表现优于ReLU。

- GELU (Gaussian Error Linear Unit,高斯误差线性单元)

- 公式:

f(x) = x <em> Φ(x),其中Φ(x)是标准正态分布的累积分布函数。常用近似:0.5x </em> (1 + tanh[√(2/π)(x + 0.044715x^3)])

- 特点:在Transformer模型(如BERT, GPT)中广泛采用,因其设计考虑了随机正则化的效果,性能优异。

(三)输出层专用函数

- Softmax:如前所述,用于多分类,将输出归一化为概率分布。

- Linear (恒等函数):用于回归任务,输出层直接输出加权和。

三、在AI基础软件开发中的实践指引

对于AI基础软件(如深度学习框架)的开发者和使用者,理解这些函数至关重要:

- 框架设计:优秀的AI框架(如PyTorch, TensorFlow)会在其核心库(如

torch.nn.functional,tf.nn)中高效实现所有这些函数,并提供自动求导支持。 - 模型构建:开发者应根据任务类型选择激活函数。一般原则:

- 隐藏层:优先使用 ReLU 及其变种(Leaky ReLU, GELU),它们是当前的最佳实践起点。

- RNN隐藏层:可考虑 Tanh 或 ReLU。

- 输出层:二分类用Sigmoid,多分类用Softmax,回归用Linear。

- 性能调优:当使用ReLU遇到神经元“死亡”时,可尝试Leaky ReLU或ELU。在非常深的网络或Transformer中,GELU或Swish可能带来增益。

- 自定义开发:研究人员有时需要为特定任务设计新的激活函数。基础软件应提供易于扩展的接口。

###

数学函数与激活函数是连接人工智能抽象理论与具体软件实现的桥梁。从基础的线性变换到复杂的非线性激活,它们共同赋予了神经网络强大的表征学习能力。掌握这份“函数大全”并理解其背后的原理,是进行高效、创新的AI基础软件开发与应用的必备条件。随着AI研究的深入,未来必将涌现出更多性能卓越、生物学可解释性更强的新型函数,持续推动着整个领域向前发展。

最新产品

免费的翻页电子书制作工具 AI驱动的基础软件引领变革

当人工智能遇上法律 开学季赠书助力人工智能基础软件开发行稳致远

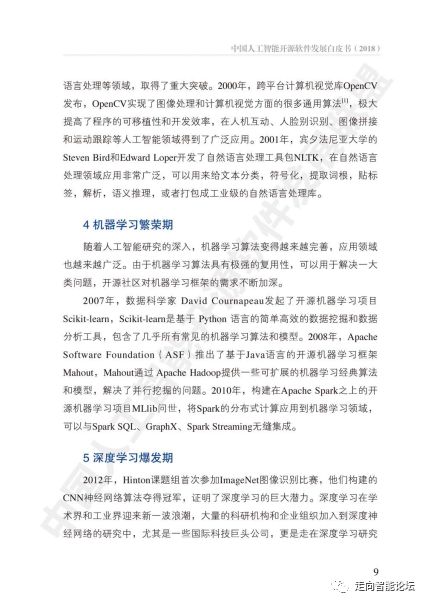

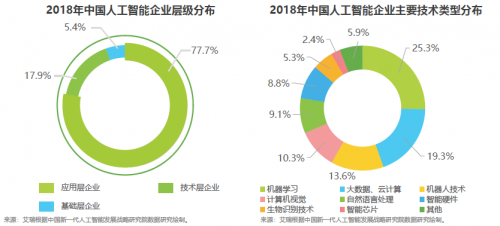

深化人工智能基础软件开发 《中国人工智能开源软件发展白皮书 2018》解读

互补共生 边缘计算与云基础设施在AI基础软件开发中的协同价值

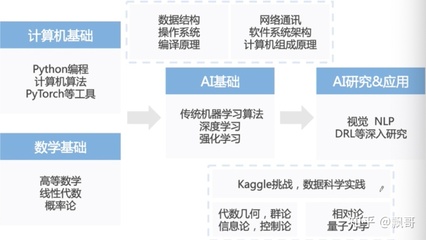

本科生人工智能学习路线 构建基础软件开发能力

英特尔数据中心级GPU 以高算力与多元化场景击破AI与HPC中心高能耗迷局

艾瑞中国AI产业研究报告发布 码隆科技领跑新零售人工智能基础软件开发

人工智能教育应该包含哪些内容——优必学的探索与发现

《人工智能实验教材 人工智能基础软件开发指南》

深度解析 人工智能基础软件开发的商业之路——现状、潜力、障碍与风险